어안중명(御眼重明) – 어안중명은 눈, 코, 귀, 입술 등 얼굴의 특정 부위를 인식해 수치화하고 이미 저장된 데이터와 유사도를 판단하여 그 결과를 알려주는 안면인식 CCTV이다. 인공지능 기술을 통해 실종 및 유괴를 당한 아이에 대한 빠른 신원 파악과 동시에 해당 아동을 찾는 업무에 주력하고 있다.

션통(深瞳) – 션통은 사람의 눈을 모델로 하여 만들어진 안면인식 CCTV로, 사각지대를 최소한으로 만들었고 최대 50m 거리에 있는 사람도 식별해낸다. 또한, 딥러닝 기법을 활용하여 사람과 행위에 대한 인식 정확도를 높이고 있으며 1초에 100명까지 식별이 가능하다. 만약 범죄자가 수많은 인파 속에 숨어 있다 하더라도 션통은 기지를 십분 발휘해 범죄자를 식별해낼 수 있다.

알파아이(阿尔法鹰眼) – 사람의 얼굴은 43개의 근육으로 이루어져 있고, 근육들의 진동 변화를 통해 약 1만 가지 표정을 만들어낸다. 육안으로는 이 변화를 감지해내기 힘들지만 심리인식 인공지능인 알파아이는 안면의 근육 변화를 감지하여 그 사람의 진실한 감정을 파악해낸다.

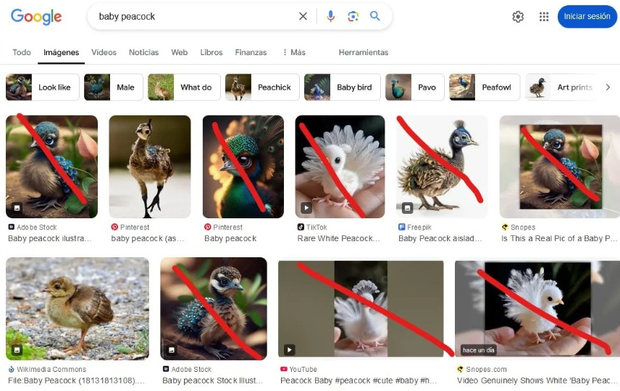

위의 3가지 인공지능 모두 그동안 기지과인에서 다루었던 안면인식 기반의 인공지능이다. 지금까지 살펴본 바로는 주로 치안 유지, 보안 혹은 범인 탐색 관련 분야에서 사용되어 왔다. 하지만 안면인식 인공지능의 활용 방법이 과연 이뿐일까?

오늘 기지과인의 주인공 후이옌샤오웨이(慧眼小微, 이하 샤오웨이)는 같은 안면인식 인공지능이지만 활용 분야에 차이가 있다. 청각장애인을 위해 개발된 샤오웨이는 독순술 능력을 가진 인공지능으로 컴퓨터 비전과 자연어처리 기술을 결합하여 화자가 말하는 입모양만 보고 발화 내용을 자막으로 나타낸다.

현재 청각장애인의 소통을 돕기 위한 기술로는 음성인식과 문자변환이 있다. 즉 보통 사람이나 청각장애인이 말하는 것을 인공지능이 그대로 받아 적어 상대방에게 보여주는 것이다. 하지만 음성인식은 시끄러운 장소에서는 정확도가 현저히 떨어지는 단점이 있는데 샤오웨이는 소리가 아닌 입모양을 보고 화자의 말을 전달하니 이를 완벽하게 보완할 수 있는 것이다.

청각장애인은 보청기를 착용하거나 인공 와우 수술을 했더라도 정상적인 청력 수준에 도달하기 어려워 원활한 소통이 힘들다고 한다. 이에 개발자 양솽(杨双)은 청각장애인이 사람들의 입모양을 보고도 소통할 수 있도록 샤오웨이를 개발한 것이다. 글씨를 쓰거나 수화를 할 필요가 없이 말이다.

명쟁암투(明争暗斗)

이번 미션은 전형적인 대결 방식으로 인공지능과 사람 전문가 간의 독순술 능력을 비교한다. 규칙은 간단하다. 대결 검증원이 방음부스에서 구령, 숫자, 문답식을 포함한 총 3가지 유형의 퀴즈를 내면 샤오웨이와 사람 전문가가 그에 맞게 행동을 취하거나 대답을 하는 것이다. 더 많은 정답을 맞히는 쪽이 승리하게 된다.

검증원은 바로 허난성 뤄허시에 있는 특수학교의 교장 선생님 치우신회(邱新会)다. 그는 독순술 교육에 20년간 종사했으며 2천 명이 넘는 청각 장애 아동을 가르친 경험이 있다.

샤오웨이와 대결을 펼칠 사람 전문가로는 치우신회의 제자인 허난성 뤄허시 특수학교 졸업생 왕차오치(王超琪)가 출현했다. 그녀는 질병으로 인해 2살 때 청력을 잃고 3살부터 독화 훈련을 받기 시작하여 20년간 사용해왔다고 한다.

첫 번째 유형은 구령 문제로 치우신회의 구령에 맞게 적절한 행동을 취하면 된다. 총 2문제가 출제되었고, 다음 1번 구령 문제를 함께 보고 행동을 취해보자.

정답은 “왼쪽으로 돌아(向左转)”이고, 샤오웨이와 왕차오치는 거의 동시에 식별했으며 모두 정답을 맞혔다. 하지만 2번 구령 문제는 왕차오치만 정확하게 의미를 파악하고 행동을 취했는데 어떤 구령인지 입모양을 자세히 살펴보자.

정답은 “왼쪽 다리 들고, 왼손 들어(抬左腿、举左手)”이지만 샤오웨이는 왼손 대신 오른손이라 판단했다.

두 번째 유형은 숫자 문제로 치우신회가 어떤 숫자를 말하고 있는지를 적는 것이다. 치우신회는 숫자의 경우 입모양이 매우 흡사하여 구분하기 어려울 것이라고 걱정했다. 숫자 문제 역시 2문제가 출제되었고, 우리도 하나씩 도전해보자.

1번 문제는 샤오웨이가 먼저 식별해냈고, 또 유일하게 정답을 맞혔다. 정답은 “2049년(2049年)”인데 왕차오치는 년을 “3”으로 판단했다.

다음은 전화번호를 식별하는 것으로 치우신회 입모양을 읽어 숫자를 적은 뒤, 해당 번호로 전화 연결을 성공해야 한다. 우리도 전화번호를 적어보자.

이 역시 샤오웨이가 먼저 식별했고 유일하게 전화 연결에 성공했다. 차오치는 기회를 한 번 더 받았음에도 숫자 문제에 약한 모습을 보였다. 정답은 “139213877XX”이다.

세 번째 유형은 문답형 문제로 의사소통에 중요한 대답 능력을 평가하는 것이다. 치우신회가 질문을 던지면 그에 적절한 대답을 하는 것인데, 다음을 보고 우리도 직접 대답해보자.

치우신회의 질문은 “세계가 이렇게 넓은데, 너는 어디에 가고 싶니?(世界那么大、你想去那儿看?)”이다. 샤오웨이는 “세계는 넓기에, 보고 싶어(世界大、想去看)”로, 왕차오치는 “세계가 이렇게 넓은데(世界那么大)”로 인식했다. 샤오웨이는 의문형이 아닌 서술형으로 인식했고 왕차오치는 뒷문장을 아예 파악하지 못해 사실상 무승부였다. 하지만 사회자가 왕차오치에게 뒷문장을 추측해보라고 하자 그녀는 “어디 가고 싶니?”라고 대답했고 본래 질문과 유사하다고 하여 그녀의 승리를 인정했다.

이로써 샤오웨이와 왕차오치의 대결은 3:3 무승부로 종료되었고 인공지능과 사람, 이 중 최후의 승리자를 가리기 위해 추가 대결을 펼쳤다. 바로 특수학교에 재학 중인 청각 장애 아동의 발화 영상을 음소거한 상태로 보고 내용을 맞추는 것이다. 다만, 이 대결에는 왕차오치가 아닌 치우신회가 직접 나섰다.

샤오웨이는 발음 교정이 잘 되지 않아 불완전한 청각 장애 아동의 입모양을 판독해야 하는 도전을 맞이한 것이고, 치우신회 역시 완전히 청각장애인의 입장에서 문제를 풀게 된 것이다. 우리도 고난도의 마지막 문제를 풀어보자.

정답을 먼저 공개한다.

“선생님 감사합니다. 당신이 제가 첫 번째 춤을 출 수 있도록 가르쳐 줬습니다. 당신이 제가 첫 마디를 뱉을 수 있도록 가르쳐 줬습니다. 우리는 항상 당신을 걱정시킵니다. 선생님 영원히 사랑합니다.(老师谢谢你。是你教会了我挑第一支舞、是你教会了我说第一句话、是我们让你总在操心,老师我们永远永远都爱你)”

다음은 샤오웨이의 답이다.

“선생님 감사합니다. 춤 한 곡, 한 문장, 영원히 사랑합니다.”

이어 치우신회의 답은 다음과 같다.

“선생님 감사합니다. 선생님은 저희에게 말하는 것을 가르쳐 주시고, 공부하는 것을 가르쳐 주시고, 춤을 가르쳐 줬습니다. 저는 춤을 아주 잘 춰요.”

양측 모두 청각 장애 아동이 말하는 내용을 정확히 파악하지 못했기에 승부를 가릴 수 없었다. 따라서 이 미션의 검증원인 치우신회가 최종 결정을 내려야 했다. 그는 보통 사람의 말을 빨리 인식하여 청각장애인에게 보여주고 알아듣기 힘든 청각 장애 아동의 말까지도 인식해내는 샤오웨이를 승리자로 인정했다.

승거목단(绳锯木断)

이번 기지과인 대결을 통해 우리 모두 소리 없는 세상을 경험했다. 드래곤아이도 치우신회와 청각 장애 아동이 하는 말을 이해해보려고 도전했으나 단 하나도 맞추지 못했다.

우리는 이전 기지과인에서 다루었던 전신마비 장애인 펑홍춘의 말을 받아 적는 음성인식 인공지능 링시(灵犀)를 떠올렸다. 그녀는 글로 작성했다면 약 이틀이 걸렸을 900자 분량의 편지를 링시를 통해 1분 20초 만에 전달했다. 링시가 100% 완벽하게 받아 적지 못했지만 그녀의 생각, 의도, 감정이 잘 전달되었고 관중들은 충분히 이해할 수 있었다.

이와 비슷한 사례로, 구글의 언어 장애 극복을 위한 유포니아 프로젝트(Euphonia Project)가 있다. 음성인식 성능을 개선하는 동시에 목소리를 잃은, 혹은 잃어가는 사람들에게 다시 목소리를 돌려준다는 목적을 지니고 있다. 아래 영상은 근위축성 측색 경화증(ALS)으로 인해 온 몸이 굳어져 가는 전 미식축구 선수 팀 쇼(Tim Shaw)가 자신의 목소리를 보존하기 위해 훈련하는 과정이다.

후반부에 들리는 목소리는 팀의 목소리를 학습한 구글 인공지능 어시스턴트가 주어진 문장을 팀의 목소리로 읽은 것이다. 마치 팀이 직접 말하는 것처럼 말이다.

펑홍춘과 팀 같은 경우 질병으로 인해 후천적으로 신체가 마비되고 발음이 어눌해진 케이스다. 최소한 말하는 방법을 알고 다른 사람의 이야기를 들을 수 있다는 뜻이다. 따라서 인공지능은 그들의 목소리를 학습하고 패턴을 감지하여 다른 사람과 소통시 실시간 음성이나 문자로 명확하게 내용을 전달하면 된다. 다른 사람의 발화 내용까지는 큰 신경을 쓰지 않아도 되는 것이다.

하지만 선천적인 청각 장애를 가진 사람의 경우 인공지능은 다른 사람의 말에 특별히 주의해야 한다. 그들이 말하는 것을 실시간으로 문자로 변환해주어야만 청각장애인이 소통할 수 있으니 말이다. 다음 영상 속에 나오는 디미트리(Dimitri)는 한 살 때 청력을 잃어 본인의 목소리를 들어본 적이 없다. 보통 사람과 대화를 하려면 항상 핸드폰을 들고 다니며 인공지능이 변환해주는 문자를 봐야 한다.

디미트리 영상을 보면 샤오웨이의 활용성이 더욱 돋보인다. 우선, 컴퓨터 비전을 통한 인식 기술이 기반이 되어 여러 명과 대화가 가능하다. 또한, 거리가 비교적 먼 사람이 말하는 것도 충분히 인식하여 소통할 수 있다. 음성인식 인공지능이 하기 어려운 일들을 샤오웨이가 실현할 수 있는 것이다.

청각장애인이 말하는 방법을 배운다는 것, 보통 사람의 말을 입모양만 보고 무슨 말을 하는지 이해한다는 것, 두 가지 모두 사실상 불가능에 가까운 이야기다. 이 한계를 극복하기 위해 나온 해결책이 수화였을 것이며, 지금까지 청각장애인과의 소통에 매우 유용하게 쓰이고 있다.

하지만 음성인식 인공지능은 수화를 넘어선 새로운 소통 방법을 제공했고, 샤오웨이는 더욱 업그레이드된 방법을 제시했다. 물론, 청각장애인에게 있어서 말하기 학습 과정 자체가 고난이고, 제아무리 인공지능이라 할지라도 사람마다 다른 입모양을 통해 내용을 파악하기란 결코 쉬운 일이 아니다. 하지만 사람과 인공지능 양측 모두의 끊임없는 학습과 상호작용이 이루어진다면 이전에는 불가능했던 일을 서서히 “가능”으로 바꿔갈 수 있다. 수화 없이 보통 사람과 청각장애인이 소통하고, 나아가 1대1이 아닌 1대다 대화가 가능한 미래가 곧 오지 않을까.

![[번역] AI 외교 시대의 도래](https://datacdn.soyo.or.kr/wcont/uploads/2024/11/03084709/%E1%84%89%E1%85%A1%E1%84%8B%E1%85%AE%E1%84%83%E1%85%B5_620.jpg)

![[기술과 사회]테슬라, “로봇 조련사”를 구하다](https://datacdn.soyo.or.kr/wcont/uploads/2024/08/23140430/%E1%84%85%E1%85%A9%E1%84%87%E1%85%A9%E1%86%BA_%E1%84%90%E1%85%A6%E1%84%89%E1%85%B3%E1%86%AF%E1%84%85%E1%85%A1_620.png)

![[번역] AI는 이미 게임 산업에서 일자리를 빼앗고 있다](https://datacdn.soyo.or.kr/wcont/uploads/2024/08/04082128/%E1%84%80%E1%85%A6%E1%84%8B%E1%85%B5%E1%86%B7%E1%84%89%E1%85%A1%E1%86%AB%E1%84%8B%E1%85%A5%E1%86%B8_620.png)

빨리 실용화 됐으면 좋겠습니다. 기대되네요