인공지능 같은 첨단기술을 언급할 때 늘 따라붙는 게 윤리 문제다. AI가 노동의 수고를 덜어주고, 온갖 편의를 제공하는 만능의 동반자 역할을 해주지만 그 이면에는 일자리 상실이나 사생활 침해, 자동화 무기 경쟁, 가짜의 부상 같은 역류가 존재하고, 이것은 필연적으로 윤리성을 소환한다. 괴물로 커지기 전에 인공지능에 윤리와 규제의 잣대가 필요하다는 것이다.

구글이나 애플, 마이크로소프트, 아마존, 페이스북 같은 첨단 기술회사들은 저마다 인공지능의 개발이나 활용과 관련한 자체 윤리지침을 갖고 있다. 안전하고, 사회에 유익이 되고, 공정해야 된다는 원칙은 대부분 비슷하다. 하지만 기술의 실제 운용이나 위해성과 윤리성의 판단은 결국 사람들의 몫이다. 외부 전문가들로 구성돼 기술과 윤리 문제를 검토하기 위한 구글의 ‘첨단기술외부자문위원회(Advanced Technology External Advisory Council, ATEAC)가 2019년 3월 말 출범 발표가 있은 지 불과 10일만에, 단 한 차례의 회의도 열리지 못한 채 백지화되었다.

위원회 구성원의 성향을 문제 삼아 직원들이 거세게 반발하고, 일부 위원의 사임까지 이어지면서 결국 없었던 일로 구글이 서둘러 진화에 나선 것이다. 공공정책 전문가이자 미국의 보수적인 연구기관인 해리티지 재단의 첫 흑인 여성 회장인 케이 콜스 제임스(Kay Coles James)가 논란의 핵심이었다. 성적 소수자와 트랜스젠더에 대한 그의 부정적 발언이 성토 대상이 되었다. 미군의 드론 활용 프로젝트에 관여한 드론 개벌업체 CEO 다이앤 기븐슨(Dyan Gibbens)도 논란이 되었다.

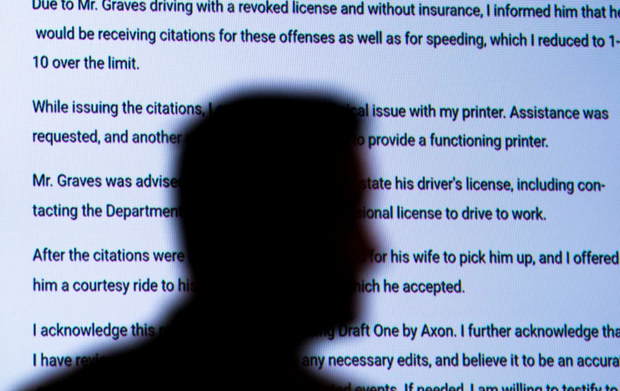

윤리 문제와 관련해 구글 내부에서 문제가 불거진 것은 이번이 처음이 아니다. 드론으로 수집한 영상자료를 분석하는 미 국방성의 시스템 개발에 구글의 AI 사물인식 기술이 활용되는데 반발해 2018년에도 4천명이 넘는 직원들이 반대 서명에 나섰다. 자사의 기술이 인명 살상에 활용될 것을 우려했기 때문이다. 결국 구글의 최고 경영자인 순다르 피차이(Sundar Pichai)가 나서 펜타곤과의 계약을 연장하지 않겠다고 발표했다. 또 이를 계기로 구글은 인공지능의 개발과 사용에 대한 윤리지침을 발표했다.

하지만 구글의 인공지능이, 그리고 또 다른 IT 기업들의 첨단 기술이 인류를 위해 평화적으로만 사용되리라는 보장은 없다. 드론 프로젝트와 관련한 논란을 수습했지만 구글은 정부나 군 당국과의 AI 기술 협력의 길을 완전히 닫아놓지는 않았다. 윤리가 추구하는 이상과 현실의 괴리, 기업의 이윤 추구와 기술의 공공성의 차이, 가치와 기준에 대한 다양한 해석 등을 모두 극복하고 동의하는 해결책을 찾는 것은 지극히 어려운 과제다.

문제는 또 있다. 기술의 해악과 윤리성이 부각되었을 때 시장에서 다른 대안을 찾기 어렵다는 것이다. 유투브를 거느린 구글은 전세계 검색 시장을 장악하며 그 옛날 몽골이나 로마도 누리지 못한 거대 제국을 형성했다. 사고의 근간인 지식과 정보를 사실상 독점하고 있는 상황이다. SNS를 평정한 페이스북이나 온라인 시장을 손에 쥔 아마존도 다를 바 없다. 이들이 가는 길이 표준이 된다. 할 수 없이 따라가야 하고, 싫어도 떠날 수 없는 게 오늘의 현실이다.

독점적 기술 기업의 윤리지침이나 윤리성 검토는 어쩌면 허울일 수 있다. 첨단기술을 앞세운 막대한 이윤 추구를 공공적 성격으로 치장하거나 소비자의 불안 심리를 잠재우는 도구로 이용하고, 공격을 무디게 하는 방패의 역할애 무게가 실릴 가능성이 있다. 뉴욕대 AI 나우 연구소(AI Now Institute)는 2018년 연례 보고서에서 ‘윤리 강령은 문제가 존재한다는 사실을 인정함으로써 기업의 기술 개발과 적용 방식이 규제를 받거나 변형되지 않고 비판에서 비켜가는 역할을 하고 있는지 모른다.’(In other words, ethical codes may deflect criticism by acknowledging that problems exist, without ceding any power to regulate or transform the way technology is developed and applied)고 지적한다.

2018년 4월 각 국의 인공지능과 로봇 분야 석학 50여명이 한국의 카이스트와의 관계를 단절하겠다고 선언해 파문이 일었다. 카이스트와 한화시스템이 AI 기반 훈련 시스템을 개발하는 ‘국방 인공지능 융합센터’를 만든 게 킬러로봇 개발로 알려졌기 때문이다. 카이스트 총장이 ‘통제가 결여된 자율무기를 포함해 인간의 가치에 반하는 어떤 연구도 하지 않을 것이라고 확인한다.’고 말하면서 논란은 가까스로 수그러들었다. 첨단 기술의 해악을 방지하는 자체 윤리지침의 효용성은 기술 기업과 연구기관의 의지에 달려있다. 하지만 이 보다 더욱 중요한 것은 상시적인 감시와 통제의 문을 안팎에 24시간 열어놓고 있는 것이다.

![[번역] AI 외교 시대의 도래](https://datacdn.soyo.or.kr/wcont/uploads/2024/11/03084709/%E1%84%89%E1%85%A1%E1%84%8B%E1%85%AE%E1%84%83%E1%85%B5_620.jpg)

![[기술과 사회]테슬라, “로봇 조련사”를 구하다](https://datacdn.soyo.or.kr/wcont/uploads/2024/08/23140430/%E1%84%85%E1%85%A9%E1%84%87%E1%85%A9%E1%86%BA_%E1%84%90%E1%85%A6%E1%84%89%E1%85%B3%E1%86%AF%E1%84%85%E1%85%A1_620.png)

댓글을 남겨주세요

댓글을 남기려면 로그인 해야 합니다.